أصبح من الصعب على مستخدمي الإنترنت التمييز بين الوجوه المنشأة بتقنية الذكاء الاصطناعي ووجوه البشر الحقيقية، الوجوه المنشأة بتقنيات الذكاء الاصطناعي تبعث الثقة أكثر من الوجوه الحقيقية، ومن جهة أخرى، تثير نتائج هذه الدراسة الكثير من المخاوف من إمكانية استخدام هذه الصور المحكمة الصنع لأغراض إجرامية...

بقلم إيميلي ويلنجهام

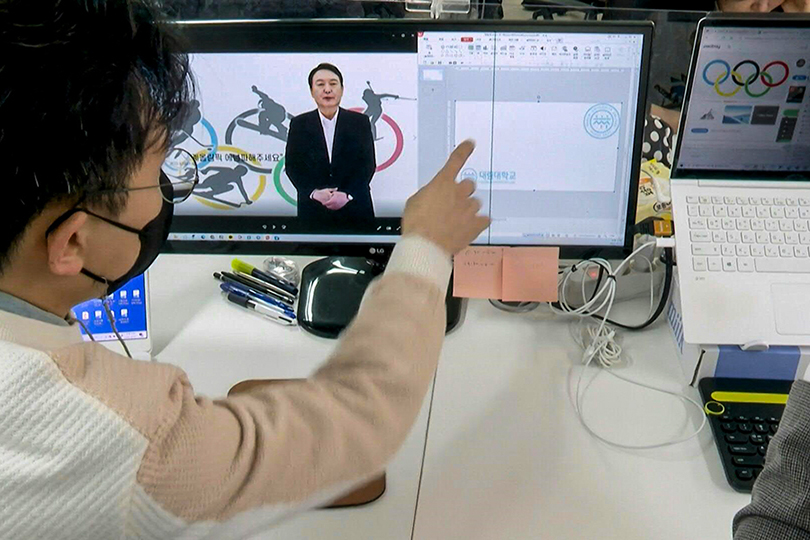

بايك كيونج-هون، مدير فريق» إيه آي يون «AI Yoon ينتج مقطع فيديو يستخدم فيه صورة منشأة بتقنية الذكاء الاصطناعي لـ"يون سوك-يول" المرشح الرئاسي عن حزب المعارضة المسمى «حزب سلطة الشعب» في كوريا الجنوبية، وتوضح الصور المبينة على الشاشة مستوى الإتقان الذي وصلت إليه مقاطع الفيديو المصطنعة والمعروفة باسم «التزييف العميق» خلال السنوات القليلة الماضية. Credit: Jung Yeon-Je/AFP via Getty Images

عندما ظهر تطبيق تيك توك عام 2021 وبدأت مقاطع الفيديو المنشورة عليه تقدم صورًا للممثل الأمريكي توم كروز وهو يؤدي حيلة سحرية تجعل عملة معدنية تختفي وهو مستمتع بتناول حلوى المصاصة، كان اسم صاحب الحساب هو الشيء الوحيد الذي يدل المشاهدين على أن هذه المقاطع غير حقيقية، وكان منشئ حساب «ديب توم كروز» (أو "توم كروز العميق") على منصة التواصل الاجتماعي تيك توك يستخدم تقنية »التزييف العميق« لخلق نسخة مُنشأة بتقنية الذكاء الاصطناعي للممثل الشهير وهو يؤدي حيلةً سحريةً أو يؤدي رقصةً منفردة.

وقد كان تأثير »الوادي الغريب« في الماضي هو إحدى العلامات التي تكشف تقنية «التزييف العميق»، وهو يتمثل في الانزعاج الذي يشعر به مستخدم الإنترنت نتيجةً للنظرة الجوفاء التي يراها في عيون الصورة المُنشأة عن طريق الذكاء الاصطناعي، ولكننا الآن نشهد ظهور صور أكثر واقعيةً تجذب المشاهدين خارج دائرة تأثير «الوادي الغريب» وتفتح أمامهم عالم الخداع المنتشر حولنا على مصراعيه بفضل تقنية «التزييف العميق».

وقد يشجع النجاح المذهل الذي حققته هذه الصور المتقَنة على استخدام هذه التقنية لأغراض إجرامية، مثل احتمال استخدامها سلاحًا في حملات التضليل لتحقيق مكاسب سياسية أو غيرها، أو إنشاء أفلام إباحية زائفة بغرض الابتزاز، أو ابتكار عدد لا نهائي من الحيل المعقدة التي تهدف إلى إيذاء الآخرين والاحتيال عليهم، وقد تحولت الجهود الساعية لابتكار آليات تساعدنا في الكشف عن المقاطع المزيفة إلى ما يشبه »سباقًا للتسلح« بين اختصاصيِّي الأمن الرقمي من جهة، وممارسي الجريمة الإلكترونية ونشطاء حروب الإنترنت من جهة أخرى.

توضح لنا دراسة جديدة نشرتها دورية «بروسيدنجز أوف ذا ناشونال أكاديمي أوف ساينس يو إس إيه» Proceedings of the National Academy of Sciences USA مدى تقدُّم هذه التقنية، إذ تشير نتائج الدراسة إلى أن البشر الحقيقيين يمكن أن ينخدعوا بسهولة بالوجوه المُنشأة اصطناعيًّا ــ بل يعدّونها أكثر مصداقيةً من البشر الحقيقيين، يقول هاني فريد، أحد مؤلفي الدراسة والأستاذ بجامعة كاليفورنيا في مدينة بيركلي بالولايات المتحدة: "وجدنا أن الوجوه المنشأة اصطناعيًّا جاءت واقعيةً ومقنِعةً للغاية، بل اعتبرها المستخدمون أكثر مصداقيةً من الوجوه الحقيقية"، ومن جهة أخرى، تثير نتائج هذه الدراسة الكثير من المخاوف من "إمكانية استخدام هذه الصور المحكمة الصنع لأغراض إجرامية".

يقول بيوتر ديديك، الأستاذ المشارك بجامعة سويسرا الإيطالية في مدينة لوجانو السويسرية، والذي لم يكن ضمن المشاركين في الدراسة: "لقد أصبحنا بالفعل نواجه مخاطر «التزييف العميق»"؛ فالأدوات التي استخدمتها الدراسة لإنشاء الصور متاحة بسهولة أمام الجميع، وعلى الرغم من أن إنشاء مقطع فيديو بنفس درجة إتقان الصور يمثل تحديًا أكبر، فمن المرجح أن تصبح الأدوات اللازمة لذلك في متناول الجميع قريبًا، وفق ما يعتقد ديديك.

تم إنتاج الوجوه الاصطناعية المستخدَمة في هذه الدراسة من خلال تفاعلات متبادلة بين شبكتين عصبيتين، وهما نوع من الشبكات يُعرف باسم «الشبكات الخصومية التوليدية»، وقد أنتجت إحدى الشبكتين واسمها «الشبكة التوليدية» سلسلةً من الوجوه الاصطناعية يزداد إتقانها واحدةً تلو الأخرى، مثلما يكتب الطالب مسودات بحثٍ ما واحدةً تلو الأخرى حتى يصل إلى أفضل نتيجة، أما الشبكة الأخرى، وتُسمى «الشبكة التمييزية» والتي تمت تغذيتها بصور بشرية، فقد تولّت مهمة تقييم الوجوه الاصطناعية بعد مقارنتها بمعطيات الوجوه البشرية.

وقد بدأت «الشبكة التوليدية» عملها باستخدام نقاط ضوئية (بيكسل) عشوائية، ثم استخدمت التغذية المرجعية التي حصلت عليها من «الشبكة التمييزية» في إنشاء وجوه واقعية تباعًا تقترب أكثر وأكثر من وجوه البشر، وعند نهاية هذه العملية، لم تعد «الشبكة التمييزية» قادرةً على التمييز بين الوجوه الحقيقية والمزيفة.

وكانت الشبكات المستخدمة في الدراسة قد جرت تغذيتها بمجموعة متنوعة من الصور البشرية تضم وجوهًا سوداء وشرق آسيوية وبيضاء من الرجال والنساء، وذلك على عكس الإجراء الأكثر شيوعًا في الأبحاث السابقة وهو الاكتفاء باستخدام صور لرجال من الجنس الأبيض.

وبعد الانتهاء من إنشاء 400 صورة لوجوه بشرية متوافقة مع 400 صورة لوجوه منشأة اصطناعيًّا، طلب الباحثون من 315 شخصًا محاولة التمييز بين الحقيقي والمزيف من بين 128 من الصور المختارة، وعلى صعيدٍ آخر، قام الباحثون بتدريب مجموعة أخرى مكونة من 219 مشاركًا وإعطائهم بعض النصائح حول كيفية اكتشاف الصور المزيفة في أثناء محاولتهم التمييز بين الوجوه، وأخيرًا، كانت هناك مجموعة مكونة من 223 مشاركًا، قام كلٌّ منهم بتقييم مصداقية 128 من الصور المختارة على مقياس يمتد بين نقطة واحدة (ليست ذات مصداقية) إلى سبع نقاط (ذات مصداقية تامة).

وقد جاءت محاولات المجموعة الأولي عشوائية؛ إذ تمكن أفراد هذه المجموعة من التمييز بين الوجوه الحقيقية والمزيفة بنسبة نجاح 84.2 بالمئة، ولم تأتِ نتائج المجموعة الثانية أفضل بكثير، إذ جاءت نسبة نجاح المشاركين في التمييز بين الوجوه الحقيقية والمزيفة حوالي 59 بالمئة، حتى مع تلقِّي هؤلاء المشاركين بعض التدريب والنصائح لمساعدتهم في عملية الانتقاء، أما المجموعة التي قامت بتقييم مصداقية الصور فقد منحت الوجوه الاصطناعية متوسط تقييم قدره 4.82، جاء أعلى قليلًا من متوسط تقييم مصداقية الوجوه البشرية الذي بلغ 4.48.

لم يكن القائمون على الدراسة يتوقعون هذه النتائج، تقول صوفي نايتنجيل، إحدى المشاركات في الدراسة: "لقد اعتقدنا في البداية أن الوجوه الاصطناعية ستكون أقل مصداقيةً من الوجوه الحقيقية".

ومع ذلك، لا يمكن الجزم بأن فرضية «الوادي الغريب» قد تراجعت تمامًا، إذ استطاع المشاركون في الدراسة التعرُّف على بعض الصور المزيفة بنجاح ساحق، تقول نايتنجيل: "نحن لا ندّعي أن كافة الصور التي أنشأناها اصطناعيًّا لا يمكن تمييزها عن الوجوه البشرية، لكن الدراسة أوضحت أن عددًا لا يستهان به منها استعصى على التمييز".

وقد ضاعفت نتائج الدراسة المخاوف القائمة بشأن سهولة الحصول على التكنولوجيا التي تكاد تجعل أي شخص قادرًا على إنشاء صور خادعة، تقول نايتنجيل: "يمكن لأي شخص أن يُنشئ محتوىً اصطناعيًّا دون أن تكون لديه معرفة متخصصة ببرامج الفوتوشوب أو الصور المنشأة بالحاسوب (CGI)"، ويضيف وائل عبد المجيد، المدير المؤسس لدى «مختبر الذكاء البصري وتحليلات الوسائط المتعددة» بجامعة جنوب كاليفورنيا الأمريكية، والذي لم يكن ضمن المشاركين في الدراسة: إن إحدى المشكلات الأخرى تتمثل في أن هذه النتائج قد تخلق انطباعًا بأن «التزييف العميق» سوف يصبح قريبًا غير قابل للكشف، ويشعر عبد المجيد بالقلق من أن يُحجم العلماء عن محاولات تطوير آليات تساعد في كشف عمليات «التزييف العميق»، على الرغم من أنه يرى ضرورة تطوير قدرتنا على كشف التزييف لكي تتواكب مع تقنيات التزوير، ويرى أن "هذه ببساطة مهمة أخرى تضاف إلى دور العلم في كشف الجرائم".

يقول سام جريجوري، مدير الإستراتيجيات البرمجية والابتكار في منظمة «ويتنس» WITNESS، وهي منظمة لحقوق الإنسان معنية جزئيًّا بأساليب كشف «التزييف العميق»: "لا يتحدث الباحثون في هذا المجال كثيرًا عن أهمية العمل بشكل استباقي لتحسين أدوات الكشف عن التزوير"، ويشير جريجوري إلى أهمية تطوير أدوات الكشف عن التزوير؛ لأن الناس في الغالب يميلون إلى المبالغة في تقدير قدرتهم على اكتشاف التزييف، مضيفًا: "إن على الجمهور أن يكون متيقظًا للاستخدامات الإجرامية لهذه الصور".

ويشير جريجوري -الذي لم يكن ضمن المشاركين في الدراسة- إلى أن مؤلفي الدراسة تناولوا هذه القضايا بشكل مباشر، واقترحوا ثلاثة حلول، منها وضع علامات مائية ثابتة على الصور المنشَأة اصطناعيًّا، "مثل وضع بصمات الأصابع داخل الصور حتى يعرف المستخدمون أنها صور اصطناعية"، على حد تعبيره.

ويختتم المؤلفون الدراسة باقتراح صادم؛ فبعد تأكيد أن الاستخدامات الإجرامية لتقنيات «التزييف العميق» ستظل تمثل تهديدات في المستقبل، نجدهم يقولون: "ولهذا، فنحن نحث الجهات التي تقوم بإنتاج هذه التقنيات على تقييم ما إذا كانت الأضرار المرتبطة بها أكبر من منافعها"، مضيفين أنه "إذا كانت الأضرار تفوق المنافع، فإننا لا نحبذ إنتاج التكنولوجيا لمجرد أننا قادرون على إنتاجها".

اضف تعليق